Sora到底是何方神圣?

龙年伊始,Sora横空出世,震惊众人。这个自称是“世界模拟器”的新工具,作为OpenAI发布的首个AI文(图)生视频模型,带给人们的感受真的只能用炸裂来形容——根据输入的文字提示,就能生成效果逼真的60秒视频,而且是可以一镜到底的那种。

仅仅在一年前,人们还在嘲笑AI生成的威尔·史密斯(Will Smith)吃意大利面的视频是人工智障。在那段视频里,威尔·史密斯用一种诡异、尴尬的姿势将意大利面铲进一张抽搐、不似人类的嘴里。

可是现在,人们对着Sora输入以下文字:

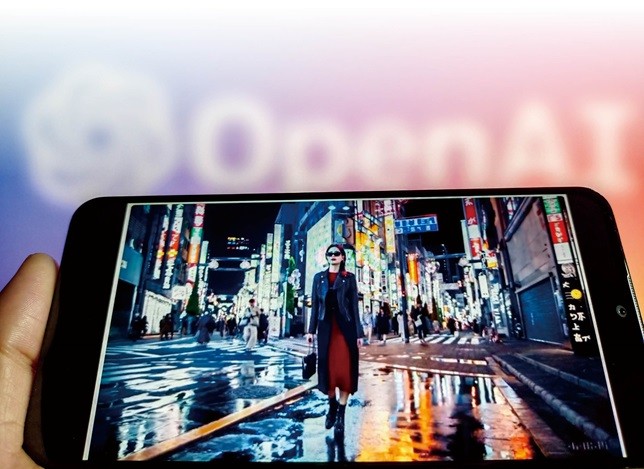

上图:Sora生成的红裙女视频,提示词中的全部细节都得到了体现。

一位时尚的女士穿着黑色皮夹克、长红裙和黑色靴子,手拿黑色手袋,在东京一条灯光温暖、霓虹灯闪烁、带有动感城市标志的街道上自信而随意地行走。她戴着太阳镜,涂着红色口红。街道潮湿而有反光效果,色彩缤纷的灯光仿佛在地面上创造了镜面效果。许多行人在街上来往。

在这段刷屏的视频中,提示词中的全部细节都得到了体现,而且无论是人物脸上的雀斑,还是水中的倒影都显得极其逼真。以前人们会怀疑,这是假的吧?现在人们会惊叹,这是实拍的吧?不像是AI生成。这种从文本到图像再到视频的进阶之路实在走得太快,以至于一年之前大佬还在预言AGI(通用人工智能)来临之前,还有很长的路要走,现在纷纷开始改口称:AIG的实现将大大提速。360集团创始人、董事长周鸿祎近日就宣称,AIG将在一到两年内实现。

Sora背后的技术架构是怎样的,Sora到底有没有理解物理世界的能力,它的出现是否意味着AGI将在一年内实现?以ChatGPT、Sora为代表的AI技术将如何颠覆人类社会既有的种种规则?我们又将如何应对?

关于Sora,我们有太多的未解之问。

Sora是不是横空出世?

过去一年多,以ChatGPT为代表的大模型现身江湖,引发科技界一片沸腾。2024年中国农历新年还没过完,AI界又发生了三件大事:谷歌推出Gemini新版本,支持超过100万个token的输入窗口;英伟达推出ChatWithRTX,誓把每个人电脑都变成一个私有大模型;当然,最震撼的还是Sora华丽登场。

近年来,AI 生成文字、生成图片的技术飞速发展。相比之下,AI生成视频领域虽有Runway、Pika 、Meta、谷歌等多个明星公司入局,但因技术难度更大,发展仍处于早期。

2023年12月,谷歌团队发布视频生成模型VideoPoet,一次能生成10秒超长、连贯大动作的视频,超过其他智能生成3~4秒的模型,已足以让业内振奋。谁能想到,2个月不到,Sora已经可以一次生成60秒钟的连贯视频,并且包含高度细致的背景、复杂的多角度镜头,以及富有情感的多个角色。

OpenAI首席执行官奥特曼在X平台上发布了一系列视频,精美的场景、逼真的人物细节让用户惊叹不已。而这些视频全都是通过OpenAI 2月15日发布的最新视频生成模型Sora制作的,人们将其描述为“绝无仅有”和“游戏规则改变者”。

1分钟的视频并不长,但对于AI文字生成视频却是一个巨大的飞跃。在此之前,文字生成视频的时长只有短短几秒,一大原因就在于,AI不知道接下来要发生什么,因而不知道该生成怎样的内容。

Sora发布的黑衣红裙女视频很好地保持了人物的连贯性,让观众也明显感受到其几乎可以“以假乱真”。当然,如果仔细观察,可以发现红裙女视频中人物的脚步在某几个帧会出现不自然的扭曲,视频中的背景广告牌虽然酷似日文,但由于目前AI还无法直接在视频中“认识”文字,其只能生成似是而非的“日文”。在另一则中国龙年舞龙的视频中,出现的也并非真正的汉字“龙”,只是像汉字的图形而已。这些都是AI生成视频的特点之一。不过瑕不掩瑜,Sora已经用事实吊打了同类型的文生视频应用。它不仅更加符合逻辑,还在一定程度上“展现”了对现实世界的理解能力。

英伟达人工智能研究院首席研究科学家Jim Fan在社交平台感叹,Sora不再是一个创意玩具,而是一个“数据驱动的物理引擎”,一个可学习的模拟器或“世界模型”,可以对真实或虚拟世界进行模拟。

那么,Sora具体厉害在哪?

如果说,之前的AI“文生视频”工具是“模拟现实”,Sora则是“构建现实”。两者的区别在于,前者是对现实的模仿,难以捕捉现实世界的物理规则、动态变化。后者,则是在虚拟世界里,构建另外一种现实。其学习的不仅是像素与画面,还有现实世界的“物理规律”。

咖啡杯里的海盗船视频,展现了人类所期望的正确物理规则。

Jim Fan对咖啡杯里的海盗船这则视频进行了拆解分析。首先,在这个视频中模拟器生成了两只带不同装饰的精美海盗船,这需要Sora在其潜在空间中解决文本到3D的隐含问题;第二,这两艘船需要在航行和避开对方路径时始终保持动画效果;第三,从流体动力学上来看,咖啡的流动以及船只周围形成的泡沫都非常自然。流体模拟是计算机图形学的一个完整子领域,传统上需要非常复杂的算法和方程;第四,在逼真度上,整体的效果看起来几乎就像使用光线跟踪渲染一样;第五,模拟器考虑到与海洋相比,杯子的体积较小,因此采用了倾斜移位摄影技术,营造出一种微景观的感觉;第六,虽然提示词中场景的语义并不存在于现实世界之中,但Sora依然实现了我们所期望的正确物理规则。

这就是Sora的独到之处,理解运动中的物理世界。复旦大学教授、上海市数据科学重点实验室主任肖仰华指出,因为世界本质上是非常复杂的,非线性的。我们传统的模型只能建一些线性的简单关系。像流体力学之类非常复杂的现象,用传统的模型非常难建模。但是今天我们看到基于Transformer深度神经网络的大模型架构,Sora已经具备了对现实世界复杂现象非常逼真的建模能力,这是Sora带来的一个新高度。

在Sora推出后不久,OpenAI发布了这款新工具的技术报告。报告指出Sora的一个强大的能力是它的语言理解能力。OpenAI利用Dall-E模型的re-captioning(重述要点)技术,生成视觉训练数据的描述性字幕,不仅能提高文本的准确性,还能提升视频的整体质量。此外,与DALL·E 3类似,OpenAI还利用GPT技术将简短的用户提示转换为更长的详细转译,并将其发送到视频模型。这使Sora能够精确地按照用户提示生成高质量的视频。

上图:Sora视频完整展现了小怪兽伸出爪子挡住红色蜡烛跳动的火焰,它的影子随之偏移的物理过程。

因为一篇张冠李戴的文章而被误称为Sora发明者之一的纽约大学计算机科学助理教授谢赛宁,实际上是机器学习领域知名学者,也是扩散模型(Diffusion Transformer,简称DiT)一篇重要论文的主要作者之一。他分析Sora应该也是一个建立在DiT架构上的扩散模型,同时结合了GPT技术的混合模型,从而在视觉领域实现重大突破。“对于Sora这样的大规模系统工程而言,神经网络架构只是其中很小一部分。大部分的功劳要归功于OpenAI的人才储备,高质量数据规模以及巨大的算力。”

简而言之,60秒超长长度、单视频多角度镜头和世界模型是Sora的三大关键词。如果没有大语言模型的加持,Sora是不可能迅速“进化”到今天这个地步的。

Sora能否理解世界?

毫无疑问,Sora目前展现出来的“逻辑能力”看似非常强大,或者说它展现出来的视频世界更符合人类观念中的现实世界。

但Sora真的能够理解世界吗?随着一系列匪夷所思的Sora视频出现,业界有了截然不同的判断。

比如在一个样片中,提示词为“考古学家在沙漠中发现了一把普通的塑料椅子,正小心翼翼地挖掘和除尘”,Sora生成的视频出现了椅子变形、自动行走等诡异的场景。

另一个玻璃杯碎裂的视频中,玻璃杯碎裂的方式也十分诡异——它被抬到半空中时,桌子上就忽然出现了一摊平整的红色玻璃,随后玻璃杯被摔到桌子上,和这摊玻璃融为一体。

很显然,Sora混淆了玻璃破碎和液体溢出的顺序,也并不能推理时间和因果关系。这不正说明,Sora目前还无法理解全部的物理世界?

再比如,Sora团队Aditya Ramesh自豪地放出一个蚂蚁巢穴内爬行的视频,粗看似乎很惊艳,仔细一看,却令人啼笑皆非——蚂蚁怎么只有四条腿?!

还有一个老奶奶庆祝生日的视频,每一帧都异常逼真,但是当老奶奶吹了生日蜡烛的时候,蜡烛的火苗竟然纹丝不动。最离谱的还是一个男人在跑步机上煞有介事地反向跑步。如此“南辕北辙的跑步”视频,让人看到了Sora“智障”的一面,这些翻车视频暂时让人们松了一口气,“输入一部小说,产生一部电影”的时代还不会马上到来。

美国纽约州立大学石溪分校计算机系顾险峰教授撰文指出,观察“幽灵椅子”视频,整个椅子如鬼魅般悬空,这与日常经验相悖。再如“四足蚂蚁”的视频,蚂蚁的动作栩栩如生,宛如行云流水。局部上非常流畅自然,令人不禁联想或许在某个星球上存在这种四足蚂蚁。但是整体上,地球的自然界并没有四足蚂蚁。这种“局部合理,整体荒谬”的生成视频,意味着Transformer学会了Token间局部的连接概率,但是缺乏时空上下文的大范围整体观念。

AI科学家马库斯(Gary Marcus)则发文表示,“我们需要认识到,并非Sora生成的所有视频都来自其训练集。Sora也并不总是遵循物理学、生物学和文化的规律。我最近讨论的7*7棋盘、4条腿的蚂蚁,和碎裂的杯子一样,都证明了Sora是一个鲁莽的野兽,而非迭代的、基于定律的物理引擎。其实,Sora只是泛化了像素的模式,而并非世界上物体的模式”。

图灵奖得主、Meta公司首席科学家、AI团队负责人杨立昆(Yann LeCun)说,在他看来,仅仅根据提示词生成逼真视频并不能代表一个模型理解了物理世界,生成视频的过程与基于世界模型的因果预测完全不同。他认为Sora并不能模拟物理世界,在社交平台上发文称 “这里存在‘巨大’的误导”。

上图:Sora生成的舞龙视频非常逼真。

对此,英伟达高级研究科学家Jim Fan表示,我们可以从两个角度来解释这个问题:(1)可能是因为这个模型根本没有掌握物理知识,它仅仅是在无序地拼凑图像像素;(2)模型确实尝试构建了一个内部的物理引擎,但这个引擎的表现还不尽如人意。就像是第一代虚幻引擎在处理流体动力学和物体变形等问题上,与V5相比有着明显的不足。同样地,V1的渲染效果也远不如V5,并且缺乏物理上的准确性。

猎豹移动董事长兼CEO、猎户星空董事长傅盛则认为Sora在某种意义上具备了对世界的理解。“但如果你说它把整个物理世界复刻了,我觉得这肯定不是真实的。我认为它对世界的理解还停留在比较初级的水平。就像一个五六岁的小孩,对世界的理解并不深,但画图方面是一个天才儿童。我认为这也是电脑特性决定的,计算机的能力和人类能力并不一样,对我们来说很难的事情对它来说可能很简单,画画对计算机来说就是一堆的像素点打出来,这个色阶正好符合你的审美。所以我觉得仅以视频本身去惊叹Sora对物理世界的理解到了一个什么高度,这点我是绝对不认同的,‘AGI因此由十年变一年’,这个我也不认同。”

大力出奇迹?

傅盛说,其实语言对世界的认知是远超视频的,虽然视频看起来更让我们有直觉的冲动,但语言的抽象和逻辑是最难理解的。一旦语言对世界的描述建立以后,视频的这种抽象和描述相对来说是简单的。OpenAI能走到今天与其说是技术积累的胜利,不如说是技术信仰的胜利;与其说是它有什么超牛的技术,还不如说它坚持在别人不相信的道路上勇敢前行。

其实即便到前年之前,OpenAI在硅谷都不是一个被看好的公司。但它自成立之初就相信一件事:让机器读大量的文字,它就能理解语言,甚至理解世界。在ChatGPT出现以前,所有人都不相信它可以实现,但它最后成功了。

Sora某种程度是ChatGPT的又一次翻版:它把视频数据统一了,然后用大语言模型的方法理解视频,最后“涌现”出了对物理世界的构建能力。他们在技术报告中指出,Sora的灵感来源于大语言模型的开发。他们利用互联网的规模数据使得大语言模型获得了通识知识的能力。而大语言模型的成功在一定程度上得益于文字编码(Tokens)的使用,它统一了不同的文字形式,包括编码、数学和不同的自然语言。Sora有了视觉数据块(pathes),可以有效表达不同种类的视频和图像数据。

上图:黄仁勋2016年向OpenAI捐出全球第一台AI超算DGX-1时,马斯克还是OpenAI的联合创始人。

当然,Sora成功的背后还离不开另外一个男人——英伟达的联合创始人黄仁勋。2月22日,英伟达市值一日暴涨2770亿美元,相当于涨出一个阿里+京东+百度,创造了人类史上最大个股单日市值增幅。英伟达目前总市值已靠近2万亿美元边缘(1.96万亿美元),超过英特尔AMD高通博通四大半导体巨头之和。2012年,当英伟达的黄仁勋决定all in AI 的时候,没人看好。但眼下,无论你是发力自动驾驶,布局元宇宙,还是研发AI大模型,都离不开英伟达的GPU(图形处理器)。

2016年,英伟达推出了全球首个针对AI计算场景的P100芯片。在此基础上,英伟达打造了全球第一台AI超算DGX-1。出人意料地,黄仁勋将这款价值12.9万美元的全球首台AI超算无偿捐给了旧金山某个非营利性机构。

捐赠仪式上,黄仁勋拿出记号笔在机箱上写道:“为了计算和人类的未来,我捐出世界上第一台DGX-1。”现在人们知道了,这家非营利性机构就是OpenAI。

8年前的一次捐赠,从某种程度上看,也是AI发展浪潮中的一个巨大隐喻:用人类的信仰创造出惊人的未来。Sora的重大突破并不一定代表技术上的重大升级,而是又一个“大力出奇迹”的时刻——相信这事能成,然后不计成本地投入巨大的算力和数据尝试。技术信仰使得他们全力以赴,从而有了一个产品级的突破。从这个角度上讲,Sora生成视频的意义在于,继语言模型突破之后,人类又迎来了视频和物理世界虚拟生成的突破,人类完全可以用数据驱动的方法让机器学习,从而产生出有可能远远超过人类对这个世界的认知方式,这或许是人类历史的伟大转折点!

近日,360创始人周鸿祎连发6段视频和1篇长文,开直播向网友“推销”Sora,“我成了布道者”,他随之宣布了“四个相信”理论:“要有AI信仰;相信AI是工业革命级技术;相信人类已经在朝着AGI(通用人工智能),甚至朝着强人工智能在指数级发展;相信不懂AI会终将被淘汰。”记者|陈冰

链接:

1.Sora是什么?

Sora是OpenAI发布的文生视频模型,能够根据用户输入的提示词、文本指令或静态图像,生成长达一分钟的视频,其中既能实现多角度镜头的自然切换,还包含复杂的场景和生动的角色表情,且故事的逻辑性和连贯性极佳。

Sora的命名或来源于日语中的单词“天空”。OpenAI团队表示,选用该词是因其让人联想到无限的创作潜力。

2.有何与众不同?

Sora具有三大突出亮点,首先是时长,Sora可生成长达一分钟的视频,且可以保持视频主体与背景的高度流畅性与稳定性;其次是单视频多角度,即在一段视频中围绕同一主体实现远景、中景、近景、特写等不同镜头的切换,且符合逻辑;此外还有理解真实世界的能力,Sora对于光影反射、运动方式、镜头移动等细节处理得十分优秀,极大地提升了真实感。

3.大语言模型(Large Language Model)

语言模型是计算自然语言每个句子概率的数学模型。当用户向 AI 提问时,AI 会通过计算概率来确定其回答。当前的语言模型不仅仅是一个问题对应一个答案,实际上是一个问题对应多个可能的答案,并根据这些答案的概率进行排序,最终返回最有可能的答案。大语言模型拥有数以亿计的参数,并在解决复杂任务时表现出令人惊叹的能力。

4.Transformer模型

Transformer模型是一种神经网络,这种模型应用了一组不断发展的数学技术,称为注意力或自我注意力,以检测甚至是系列中遥远的数据元素相互影响和相互依赖的微妙方式。自注意力机制的创新,使得模型能够在捕捉长距离依赖关系的同时实现并行计算,大大提高了模型的性能和效率。无论是在自然语言处理还是计算机视觉领域,都成为了一种不可或缺的重要工具。

5.涌现能力

涌现理论的主要奠基人约翰·霍兰德(John Henry Holland)在《涌现:从混沌到秩序》一书中这样描述“涌现”现象:“在复杂的自适应系统中,‘涌现’现象俯拾皆是:蚂蚁社群、神经网络、免疫系统、互联网乃至世界经济等。整体行为远比构成它的部件复杂,可称为‘涌现’。”

涌现在AI领域的表现为,当大模型的参数与数据量足够大时,突然就“涌现”出了惊人的智能,即实现AI 的自我进化,能举一反三,触类旁通。